Новая платформа Supermicro 6026TT-IBXF.

В платформе используются четыре независимых вычислительных модуля, с общим электропитанием. Здесь конфигурация с одним из двух возможных БП.

Все модули вставлены вид сзади. У каждого модуля свои отдельные сеть, VGA, USB.

Кнопки включения питания расположены для каждого сервера в отдельности.

Целиком вынутый модуль.

Все модули-сервера вынуты. В системе остались только вентиляторы и корзина с дисками.

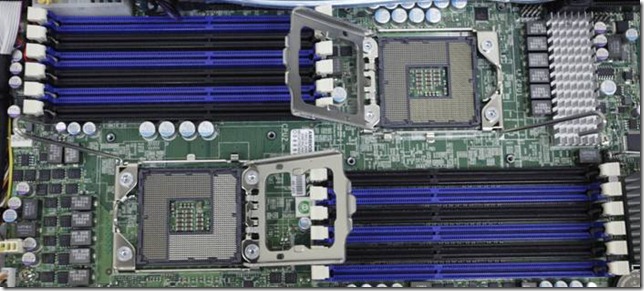

Каждый модуль можно оснастить двумя высокопроизводительными процессорами Nehalem-EP. Ограничение для процессоров – термопакет, он не должен превышать 100W, но почти все процессоры удовлетворяют этому требованию.

На каждый модуль приходиться по 3 SATA диска. Этого достаточно для организации отказоустойчивого массива под систему. Жесткие диски связаны с конкретными модулями-серверами по слотам.

С памятью никаких необычных решений. Все штатно согласно функционалу чипсета, Intel 5500 (Tylersburg), 3 канала на процессор. На каждое лезвие максимально можно установить либо 48 Гб DDR3 ECC Registered DIMM, либо 24Гб Unbuffered. Частота 1333/1066/800 MHz.

В каждый модуль интегрирован IPMI, что упрощает управление сервером, позволяя полностью контролировать его через LAN. Так же на плате уже распаян Mellanox ConnectX DDR Infiniband 20Gbps Controller, наружу выведен разъем QSFP. Infiniband дает возможность организации быстрого интерконекта с низкой латентностью между серверами.

Все остальные решения совершенно стандартные для серверов на платформе Nehalem. За исключением использования в платформах с процессорами Nehalem-EP, моста ICH10R, в данном случае он используется для возможности собрать RAID массив.

Для тех кому не хватает дискового пространства или нужно что-то более производительное и надежное, каждый сервер оснащен PCI-E x16. Это позволяет при необходимости установить дополнительные карточки для подключения массива по iSCSI или более дорогую FC, либо любую другую совместимую. Или все, что ваша душа пожелает, но карта должна иметь LP форм фактор.

Система вентиляции. Сразу за вентиляторами располагаются 2 сервера, друг над другом.

Сильно порадовало что все куллера больше не прикручены насмерть саморезами к железу. Все аккуратно сделано на резиновых фиксаторах, и с резиновыми прокладками. Это существенно уменьшает уровень шума и вибрацию.

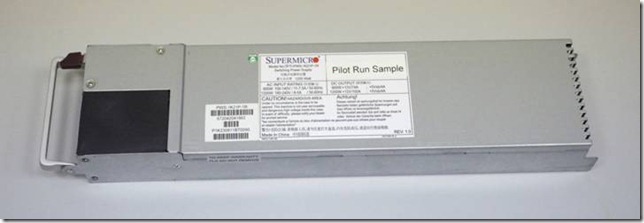

Что касается питания в базовой комплектации модуль только 1 мощностью 1200W. Для избыточности нужно купить дополнительный.

Модуль для подключения двух БП. расположен в центре корпуса, между серверами-модулями.

Платформа в сборе с открытой крышкой. Под видимыми модулями-серверами располагается второй слой.

http://supermicro.com/products/system/2U/6026/SYS-6026TT-IBXF.cfm

Характеристики:

| Four systems (nodes) in a 2U form factor. Each node supports the following: 1. Dual Intel® 5500 series Xeon® Quad/ 2. Up to 48GB DDR3 1333/ 1066/ 800MHz 3. 1 (x16) PCI-E ( Low Profile) 4. Integrated IPMI 2.0 with KVM and 5. Mellanox ConnectX DDR Infiniband 6. Intel® 82576 Dual-Port Gigabit 7. 3x Hot-swap SATA Drive Bays 8. 1200W Gold-level High-efficiency CPU QPI System Memory (per Node) Memory Capacity Memory Type DIMM Sizes Memory Voltage Height | On-Board Devices (per Node) Infiniband Chipset SATA IPMI Network Controllers Graphics Super I/O Clock Generator Input / Output LAN USB VGA Serial Port Infiniband |

Отдельное спасибо Куликову Диме за помощь в подготовке.

![clip_image002[7] clip_image002[7]](https://blogger.googleusercontent.com/img/b/R29vZ2xl/AVvXsEjbdr_OatZzgcX7fPyMX4HwR16FFmsjaDMLt5M7V8o7z_vkSg8-T9M9vKaHK0UvcRo8ZbQ3iIZRY15cLcmr19NZhXOBTrzJdNfleNbqZTOFeFj9XhKPFJAbCJ5qv3IRgHKOZi8HHBLfbiMb/?imgmax=800)

Микро блэйд такой.

ОтветитьУдалитьПо расчетам, IP-TV Encoder/transcoder IP-IP на нем получился существенно дешевле чем 4 равнозначных сервера...

Можно и так применять. По моему ощущению - идеальная платформа для вычислительного кластера. Плотность высокая, инфинибэнд на борту, сетевых карточек еще наставить можно.

ОтветитьУдалитьЭтот комментарий был удален администратором блога.

ОтветитьУдалить