По случаю Дня Победы (и наверное не только по этому случаю), в IBM анонсировали целый ряд существенных улучшений в и без того популярных системах серии DS3500 – DS3512 и DS3524. На самом деле, 9го мая были и другие (зачастую не менее значимые) анонсы в области систем хранения IBM, но про них в другой раз. Так что же теперь еще есть в DS3500?

- Самое заметное нововведение – в два раза увеличено количество поддерживаемых дисков. Теперь в одной DS3500 может быть до 192 жестких дисков SAS и/или NL SAS. Для этого потребуется докупить соответствующий ключ активации. Тем самым, можно получить до 384ТБ raw ёмкости на систему при использовании 3.5" NL SAS дисков 2ТБ и до 192ТБ raw ёмкости на систему при использовании 2.5" NL SAS дисков 1ТБ (которые, кстати, также были анонсированы 9го мая).

- Поддерживается до 128 Storage Partitions, а также до 256 томов на каждую “partition”. Суммарное же количество поддерживаемых томов увеличено до 512 на систему.

- Дополнительная опция позволит создавать до 16 пар томов (вместо 8ми, которые были доступны ранее) при использовании Remote Mirroring (синхронная и асинхронная репликация).

- Для тех, у кого активированы FlashCopy и/или VolumeCopy получат поддержку до 256 копий на систему (количество копий на том остается без изменений). Более того, теперь нет никакой необходимости приобретать ключи активации для FlashCopy upgrade и VolumeCopy upgrade – достаточно Base версии чтобы получить максимум возможностей.

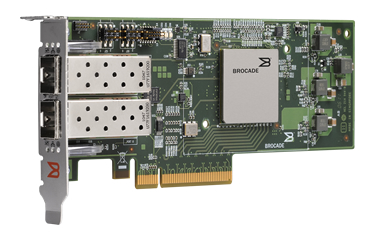

- Для тех, кто заинтересован в использовании iSCSI, но 1Гбит интерфейсы не устраивают по производительности, есть приятная новость – анонсированы интерфейсные платы с портами 10Гбит. В результате, можно получить по два 10Гбит порта на контроллер (4x10Гбит на двухконтроллерную систему). Примечательно, что используются не привычные SFP+ порты, а RJ45. Так как порты на новых картах могут работать и на 10Гбит, и на 1Гбит, можно смело использовать эти интерфейсные платы даже без инфраструктуры 10Гбит, а рассчитывая на ближайшую перспективу.

Помимо “железных” возможностей, появились улучшения и в плане управления системой:

- Для периодического создания мгновенных снимков вместо скриптов (в определенных случаях) можно использовать расписание, настраиваемое через GUI в DS Storage Manager (также его можно настроить и в CLI).

- Теперь вовсе необязательно при создании VolumeCopy вручную делать FlashCopy, чтобы обеспечить непрерывный доступ к исходному тому – опция “Online VolumeCopy” позволит автоматизировать процесс и соответствующий снимок будет создан в системе без участия администратора.

- Но наиболее интересная для меня новость – улучшения в Performance Monitor, который теперь научился показывать не только realtime результаты, но и накопленные за период значения (до 7ми дней):

Это позволит нам существенно упростить жизнь при поиске потенциальных проблем и при анализе производительности системы.

Сейчас, благодаря этим новшествам, системы DS3500 стали еще привлекательнее для пользователей и способны занять не только нишу начального уровня, но и составляют серьезную конкуренцию системам класса MidRange. Осталось только дождаться поддержки SSD!

Читать дальше ...